Entretien avec un robot: ChatGPT

Un défi qui reste à relever

Assisterions-nous à une nouvelle vague épidémiologique d’un battage publicitaire disproportionné sur les miracles tant attendus de l’intelligence artificielle ? On peut se le demander avec les articles incessants depuis un mois sur le robot conversationnel ChatGPT.

Pour en avoir le cœur net, j’ai décidé de tester quelques questions via l’interface mise à disposition par OpenAI. Pour me faire ma propre idée de son utilité (ou pas) ainsi qu’en cerner les limites. Certes, baptiser cela entretien est légèrement exagéré, le robot n’étant qu’un instrument que j’ai fait jouer selon ma partition. En conséquence, il me semble d’une part que l’enthousiasme vis-à-vis de ChatGPT est trop exagéré et d’autre part, qu’il peut être utile, à condition de ne pas se leurrer sur ses capacités.

Il serait difficile, voire impossible, de distinguer un texte écrit par ChatGPT d’un texte écrit par un humain. Cela pourrait duper des millions de personnes. L’usage du robot menacerait des professions entières : journalistes, programmeurs, enseignants, responsables marketing et autres. OpenAI aurait l’intention d’introduire une manière de distinguer la production du robot conversationnel grâce à un filigrane numérique caché, un motif de distribution des mots qui paraîtrait aléatoire mais dont la génération suivrait un processus déterminé. Ce motif pourrait toutefois être contourné.

Que dire de tous ces conditionnels ? Factuellement, les peurs et les enthousiasmes générées par ChatGPT suscitent beaucoup de textes humains. Serait-ce toutefois beaucoup de bruits pour rien ? En réalité, ChatGPT devrait nous lancer le défi qu’il ne relève pas. Celui de réfléchir et faire réfléchir mieux, et augmenter nos capacités de critiques constructives sur des raisonnements solides et explicables. Car l’analyse des réponses de ChatGPT me conduit à rester très nuancée sur ses capacités.

Un texte aussi synthétique qu’une fleur artificielle

source image : flickr, https://www.flickr.com/photos/akgypsy37/

JLS Photography – Alaska licence CC-NY-NC-ND 2.

Le texte de ChatGPT est autant comparable avec celui d’un humain, qu’une fleur artificielle l’est avec une fleur réelle. La forme est bonne, la matière est décevante.

L’analyse des textes produits par ChatGPT ne confirme en rien les prouesses miraculeuses vantées par ses zélotes. On y voit une synthèse syntaxiquement correcte d’informations collectées, un semblant de capacité à structurer les parties -pour peu que les questions s’enchaînent bien, mais rien qui s’apparente à une mise en perspective des textes utilisés. Si c’est censé révolutionner le travail des journalistes, des enseignants, des chercheurs et des étudiants … On a un problème non pas avec le robot, mais avec ceux qui l’estiment intelligent. Tout dépend néanmoins de ce qu’on entend par intelligence.(voir Encart1)

A ce titre, les ressorts de l’enthousiasme généré devraient nous alerter sur une certaine forme d’appauvrissement de nos échanges intellectuels.

Il y a ceux qui aiment échanger sur des sujets qui leur tiennent à cœur sans chercher à apprendre quoi que ce soit de leur interlocuteur. Ils jugeront pertinent ce qui les conforte dans des savoirs déjà acquis ou dans leur position de sachants. D’autres ont tendance à prendre pour vérité toute affirmation qui leur plaît dès lors qu’elle est relayée. Ces derniers ne chercheront pas à distinguer les probabilités de la réalité, les corrélations des déductions. Enfin, certains s’enthousiasment à la perspective d’obtenir une forme de valorisation rapide via des textes produits facilement, sans trop d’efforts. ChatGPT plaît aussi pour tout cela.

La capacité à faire illusion n’est pas la compréhension

Nombreux également sont ceux qui ne savent pas distinguer le processus intellectuel destiné à déduire des informations utiles par l’action de comprendre quelque chose (par exemple, les caractéristiques d’une situation, un environnement, les propriétés d’une réaction, etc.), d’avec la capacité à reproduire des informations sur ce quelque chose.

On peut apprendre par cœur une définition sans forcément bien la comprendre, sans être le moins du monde expert du domaine et toutefois, faire illusion. ChatGPT m’évoque le personnage de Gaspard Lalouette dans l’intrigue du fauteuil hanté de Gaston Leroux. Ce candidat à l’académie française ne sait pas lire! Toutefois, il convainc des académiciens de son érudition en répétant des définitions du dictionnaire (voir Encart2)

Un académicien ne sachant pas lire, l’idée est originale. Un robot ne sachant pas réfléchir, c’est en revanche très commun. ChatGPT, malgré des articles laudateurs et des enthousiasmes à l’emporte-pièce, ne déroge pas à la règle. Certes, ChatGPT n’a pas besoin d’apprendre quoi que ce soit par cœur pour avoir la capacité d’accéder à tout ou partie de milliards de textes, les combiner et les restituer en fonction des bons mots-clefs, de synonymes ou de mots apparentés, ou de l’ordre des mots. Est-ce que cela pourrait en faire un bon académicien ?

– Voilà bien ce qui me tracasse, pourrais-je dire, tel un monsieur Lalouette. Qu’on confonde la capacité à collecter des informations et à les restituer de manière fluide, avec de la réflexion.

ChatGPT : un bon limier pour chercher l’information

L’usage de ChatGPT s’applique bien à la démarche de veille. Pour trouver de l’information utile, il faut toujours savoir formuler de façon pertinente les questions auxquelles on souhaiterait des réponses, rien de bien neuf là-dedans. ChatGPT pourrait dès lors être un assistant bien plus efficace que vous dans la recherche sur de gros volumes de textes (dont Internet) pour collecter les informations et les restituer clairement de manière synthétique. Vous pouvez écrire vos questions en n’importe quelle langue, voire en plusieurs, et demander une réponse dans l’une ou l’autre.

Du point de vue de la forme, ce sera déjà mieux grammaticalement que la production de beaucoup d’étudiants.

De plus, ce ne sera pas une simple recopie, mais un texte nouveau, fondé sur une reformulation concise de plusieurs sources textuelles combinées en entrée. Pour une synthèse exploitable c’est intéressant, pour un travail d’analyse de bonne qualité, j’ai des doutes.En tant que modèle de langue entraîné sur un grand nombre de textes, je suis généralement capable de fournir des réponses avec une orthographe et une grammaire correctes.

ChatGPT

Car on peut douter de l’originalité et de la profondeur du résultat, n’en déplaise à certains. Aussi bien que trouver à redire à la forme ampoulée, tellement elle suit des principes de structuration de dissertation très scolaires. On pourrait également souhaiter voir citer les sources de manière appropriée, ce qui n’est pas le cas.

ChatGPT peut assister des codeurs, pas remplacer les vrais

Le code informatique étant un langage, on peut aussi utiliser ChatGPT pour générer du code en différents langages de programmation, et gagner du temps.

On trouve sur Reddit des personnes très satisfaites de l’usage de l’outil pour réaliser des études de cas dans le marketing de l’expérience utilisateur, ou pour corriger un code, ou pour convertir un langage de programmation en un autre.Le principal problème est que même si les réponses produites par ChatGPT ont un taux élevé d’erreurs, elles ressemblent à de bonnes réponses et sont très faciles à produire. De nombreuses personnes essaient dès lors ChatGPT pour créer des réponses, sans l’expertise ou la volonté de vérifier que la réponse est correcte avant de la publier.

modérateurs de Stack overflow

Néanmoins, n’embauchez pas ChatGPT pour coder vos programmes ! Si vous n’êtes pas capables de comprendre ce qui vous est restitué, vous n’arriverez à rien.

Si des programmeurs seniors posent des questions à ChatGPT ils pourront en tirer parti pour gagner du temps. Cependant, le code généré étant approximatif et contenant des erreurs, il faut l’optimiser et le corriger. Donc, il faut déjà posséder une bonne expérience de la programmation pour que ChatGPT soit un assistant utile. Il vous restera toujours à créer l’ensemble du code et surtout, comprendre les problèmes qu’il est censé résoudre. De plus, vous n’avez aucune garantie que les réponses fournies par ChatGPT soient justes. Bien au contraire, puisque la plateforme d’échange entre codeurs, Stack Overflow, a banni les réponses générées par ChatGPT, trop souvent incorrectes.

Est-ce que ChatGPT peut effectuer des tâches de raisonnement?

Moi : what kind of reasoning are you able to perform?

ChatGPT : As an artificial intelligence, I am able to perform a wide range of reasoning tasks and functions. I have been trained on a large dataset of text and have learned the patterns and structures of language, which allows me to understand and interpret natural language and to generate responses to user queries based on my understanding of that language.

Some specific reasoning tasks that I am able to perform include:

1. Information retrieval: I am able to search through my training data and retrieve relevant information in response to user queries.

2. Natural language processing: I am able to understand and interpret natural language and to generate responses that are appropriate and coherent in the context of a conversation.

3. Decision making: I am able to make decisions based on my understanding of a given situation and the information that is available to me.

4. Problem solving: I am able to identify problems and generate solutions based on my understanding of the problem and the information that is available to me.

En puriste, je soulignerai que le point 1 n’est pas du raisonnement. Concernant le point 2, l’interprétation de l’outil ne ressemble en rien à de la réflexion et enfin, ChatGPT n’est certainement pas aussi efficace que souhaité dans la prise de décision et la résolution de problème.

Pour le point 2, je renvoie à un post Facebook d’un certain Darren Hudson Hick, qui a été confronté à son premier plagiaire via ChatGPT. Lequel apparemment a rencontré des difficultés à interpréter Hume et le paradoxe de l’horreur. Avis aussi aux amateurs, méfiez-vous des citations fausses ou fictives dans les réponses. Mais vous pouvez toujours demander à ChatGPT de corriger cela.

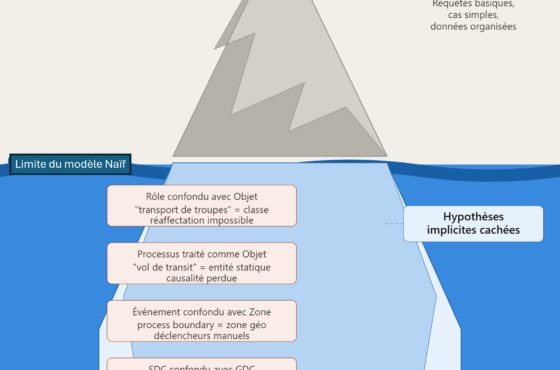

Ne vous leurrez pas sur les capacités de ChatGPT

Quant au point 4, si les déductions sont du ressort du sens commun, cela a une forte probabilité de fonctionner (ChatGPT peut interpréter des liens de parenté type neveu ou oncle). Néanmoins, on peut s’interroger sur le niveau de raisonnement.

Je me suis amusée à lui poser le problème combinatoire proposé par Einstein. Une personne enthousiaste s’exclamerait : il a trouvé la bonne réponse ! Certes, mais les explications données pour justifier la solution étaient fausses. La machine devait avoir la solution dans ses données en entrée, mais n’a pas su construire un raisonnement logique valable pour y arriver.

Si l’originalité se mesure à la possibilité d’imiter un ton sarcastique, un type de prose (voir Encart3), ou de faire des associations d’idées, ou de faire du mimétisme quel qu’il soit, ChatGPT pourrait, à première vue, paraître original, voire créatif ou innovant. On innove bien en faisant du biomimétisme. De nombreuses techniques de créativité incluent des associations d’idées en fonction de superposition de mots. Certaines peuvent être partiellement automatisées et systématisées, pour proposer des choses qui peuvent paraître innovantes, mais qui le seront fortuitement.

Quand ChatGPT s’essaye à fournir des réponses qui sortent des sentiers battus, il cherche juste des choses improbables. Croire qu’il pense hors du cadre (« outside the box ») n’est effectivement qu’une croyance, pas une réalité. D’ailleurs, l’outil a été conçu dans un cadre, celui de son entrainement. Il ne s’exerce pas hors de ce cadre, comme l’indiquent régulièrement ses réponses.

ChatGPT a été conçu davantage pour imiter que pour créer. Mais on peut lui poser cette question “Jusqu’à quel point tes réponses peuvent inclure de la créativité ? »

ChatGPT est créatif … dans le cadre de ses limites

ChatGPT : I am able to generate responses that may include elements of creativity or originality, depending on the specific nature of the query and the information that is available to me. […]

However, it is important to note that my responses are generated based on the information that I have been trained on, and my ability to be creative or original is limited by the scope and quality of that training data.

Moi : associer des idées n’est pas forcément créer

ChatGPT : You are correct that generating new ideas or solutions to problems can involve more than simply combining or associating existing ideas. Creativity often involves the ability to think outside the box and come up with original ideas or approaches that may not be immediately apparent.

As an artificial intelligence, I am trained on a large dataset of text and have learned the patterns and structures of language, which allows me to generate responses and provide information based on my understanding of the language and the information that I have been trained on. While I may be able to generate responses that include elements of creativity or originality, my ability to do so is limited by the scope and quality of the training data that I have been provided with.

Le robot peut-il remplacer un professeur ?

ChatGPT est de ce point de vue sans aucun doute limité, même s’il n’est pas complètement inutile et un peu plus qu’un simple jouet tel que Ian Bogost le décrit dans l’article « ChatGPT Is Dumber Than You Think ».

ChatGPT produit un texte par imitation, pas par réflexion. Il peut faire l’affaire pour faciliter un travail de synthèse d’éléments en entrée. Si c’est suffisant pour des étudiants et des responsables marketing, c’est que, malheureusement, cela satisfait le niveau d’attente de certains professeurs ou de clients potentiels, ou des utilisateurs de produits. Après tout, créer un discours marketing à destination des acheteurs n’est pas une œuvre de raisonnement.

Quant aux étudiants, qu’apprennent-ils à travers ChatGPT ? Qu’ils peuvent l’utiliser pour tricher ? Pour envoyer des lettres de motivation stéréotypées ?

Des pédagogues optimistes diront que certains apprennent mieux par le jeu des questions et réponses. ChatGPT pourrait-il être un outil d’apprentissage ? Si vous savez formuler les questions adéquates et vérifier les réponses au-delà de simples définitions ou de traductions, oui. Or justement pour le faire, il faut déjà avoir un peu de connaissances. C’est donc davantage un coach en révision qu’un outil pour plagiaire borné, car le résultat dépendra du niveau en entrée.

De toute façon, les outils pour détecter le plagiat par GPT arrivent en même temps que le problème.

Au final, qu’apprendre de ChatGPT ?

ChatGPT démontre pour partie l’évolution de certaines technologies d’intelligence artificielle. Si vous avez du temps pour approfondir le sujet, lisez la seconde édition (2021) du livre blanc sur l’intelligence artificielle de l’INRIA et le « Artificial Intelligence Index Report 2022 » de Stanford HAI, ils vous en apprendront bien plus.

Mais l’emballement médiatique actuel autour de ChatGPT risque de faire passer des outils pour la potion magique d’un quelconque charlatan. Le robot ne va pas réfléchir à votre place. Son utilité est d’ailleurs questionnable, quand d’autres outils peuvent s’y substituer.

Son côté vampire est encore plus questionnable… En termes de communication, l’outil vampirise une attention qu’il ne mérite pas. De plus, pour le tester, vous devez confier non seulement votre email mais aussi un numéro de téléphone mobile. Une bonne façon d’aspirer des données personnelles. Il vampirise des auteurs en outrepassant toutes licences (copyright ou copyleft) car ne citant jamais les sources de ses réponses. En le testant, il aspire également votre temps et vos efforts pour l’améliorer. Le retour sur investissement n’est d’ailleurs certainement pas de votre côté.

Ainsi que l’écrit Edward Ongweso Jr, il est temps de calmer le jeu à propos de ChatGPT. Son principal intérêt pour moi est de démontrer, avec les erreurs de raisonnement de ses réponses, que le sujet d’une explainable AI sérieuse est plus que jamais d’actualité. (voir Encart4 pour la définition XAI que donne ChatGPT)

Encarts

Encart1

Moi: if you consider that intelligence is a broader concept than memorization that includes the ability to understand, reason, and solve problems, could you say that you have an understanding of that phrase and the ability to reason about your own intelligence or the lack of it and solve problems?

ChatGPT (extrait): In terms of my own intelligence, I have been designed to have a high level of intelligence and to be able to perform a wide range of tasks and functions. However, it is important to note that my intelligence is limited by the scope and quality of the training data that I have been provided with,

Encart2

L’intrigue du fauteuil hanté, de Gaston Leroux, commence avec les angoisses d’Hippolyte Patard. Ce dernier, secrétaire perpétuel de l’Académie française, désespère de trouver un successeur à Monseigneur d’Abbeville. Car chaque nouveau candidat à l’immortalité désigné pour occuper son fauteuil meurt lors du discours d’hommage à son prédécesseur.

Quand plus aucune sommité des lettres n’ose postuler, apparait un candidat improbable : Gaspard Lalouette, simple antiquaire et marchand. Intervenant dans une discussion sur l’origine des mots abajoues et bajoues, puis d’abaque, il convainc les académiciens de son érudition. Las, il révèle son secret peu après au secrétaire perpétuel : il ne sait pas lire. Cependant, sa femme l’aide à apprendre le dictionnaire par cœur et il a presque fini la lettre A. Toute son érudition tenait donc à la restitution intégrale de deux entrées du Larousse. Malheureusement, un discours d’entrée à l’académie: naturellement, c’est beaucoup trop long pour qu’on l’apprenne par cœur.

Encart3

testons le style Marc Twain

Me : so ok, let’s try a style similar to Marc twain about this question : what can you tell about 2023?

ChatGPT : Ah, 2023! Now there’s a year for you, my dear friend.

I tell you, there’s just no telling what kind of shenanigans we’ll get up to in 2023. It’s a ways off yet, but I have a feeling it’s going to be a doozy.

Now, I ain’t no fortune teller, so I can’t predict exactly what’s going to happen in 2023. But I’ll tell you this much: if the past is any indication, we’re in for a wild ride. Things are always changing and evolving, and there’s no telling what kind of twists and turns the future has in store for us.

But that’s okay, because as long as we keep our wits about us and a sense of humor in our back pocket, we can handle just about anything that comes our way. So let’s raise a glass to 2023, my friend. Here’s to an exciting and unpredictable year!

Poursuivons pour tester le sens de la dérision

Me : I don’t think it’s as good as Mark Twain. I should reply that if you have your wits and sense of humor in your back pocket, as soon as you sit, you will lose them.

ChatGPT : I apologize if my response did not fully capture the style and humor of Mark Twain. As an artificial intelligence, I am not able to replicate the writing style of a specific individual with perfect accuracy.

My responses are generated based on my understanding of language and the information that I have been trained on, and my ability to generate responses in a particular style is limited by the scope and quality of that training data.

However, I appreciate your feedback and will try to improve my responses in the future. Thank you for pointing out that it is not possible to keep one’s wits and sense of humor in one’s back pocket, as sitting would cause them to be lost. I will make sure to keep this in mind as I generate future responses.

Encart4

Explainable AI (XAI) is a type of artificial intelligence (AI) system that is designed to provide clear and understandable explanations for its decision-making processes and predictions. This is particularly important in fields such as healthcare, finance, and the justice system, where the consequences of an AI’s decisions can be significant and the ability to understand and trust the AI is essential. Explainable AI can be achieved through a variety of techniques, such as using simpler models that are easier to understand, creating visualizations of the decision-making process, and using techniques such as natural language generation to provide clear explanations in plain language.

ChatGPT answer to “what is Explainable Ai”

PS

J’ai utilisé l’anglais pour distinguer les réponses de ChatGPT. Il peut répondre en français, mais on décèle un peu moins d’aisance.

moi : je souhaiterais une réponse en français à la question suivante : tes réponses seront syntaxiquement correctes dans toutes les langues ou tu as été moins entraîné sur certaines?

ChatGPT : Je suis capable de répondre en français de manière syntaxiquement correcte. Cependant, je suis un modèle de langue généraliste, donc je peux répondre dans de nombreuses langues différentes et j’ai été entraîné sur un grand nombre de textes dans chaque langue. Cela signifie que ma capacité à répondre de manière syntaxiquement correcte peut varier légèrement d’une langue à l’autre, bien que j’essaie de fournir des réponses aussi précises et précises que possible dans chaque langue.

Le secret du succès médiatique de ChatGPT réside sans doute dans le fait qu’il faille réfléchi dur, pour lui poser des questions qui permettront de discriminer blabla structuré, grammaticalement correct, et réponses ayant du sens…

Il faut également réfléchir dur pour analyser les textes produits sans y injecter un sens qui n’y est pas volontairement.

Je réfléchis dur à une logique d’enchaînement de 3-4 questions qui le fasse…. mais c’est pas facile…. 😉

Je ne sais pas si le succès médiatique de ChatGPT vient du fait qu’il nécessite de la réflexion sur les questions ou si son succès médiatique doit nous amener à réfléchir davantage aux questions de représentations fantasmées associée à l’IA. Autrement dit, se poser la question de savoir si on assiste là à un vrai usage pertinent des technos d’IA générationnelle auxquelles on associe une interface chatbot. ChatGPT est du domaine du divertissement.

Il faut voir le nombre d’articles qui s’en donnent à cœur joie sur des questions ou on aura toujours une réponse listant les arguments « pour » et « contre », type « on a testé avec ChatGPT si Nantes est en Bretagne », ou « on a testé avec ChatGPT si on doit dire pain au chocolat ou chocolatine », ou « on a testé avec ChatGPT si le Mont Saint-Michel est Normand ou Breton », etc… Au-delà du côté ludique, effectivement, si on dépasse le clivage des questions où on aura toujours des réponse du type « pour » ou « contre », et qu’on se met vraiment dans une démarche de collecte utile, obtenir un usage intéressant de ChatGPT impose un coup de billard à trois bandes.

Sachant que ce n’est pas une IA robuste et que ses réponses ne sont pas fiables.

A partir des réponses, on peut, par exemple, identifier des sources à surveiller, ou des approches à approfondir.

Un dernier mot : ChatGPT est une IA faible généraliste. [correction 31/01/2023. Les termes employés prêtent à confusion. C’est Une IA disposant d’une « intelligence étroite » s’appliquant à des contextes multiples. C’est-à-dire une IA qui agit dans un ensemble limité d’environnements ou de paramètres]. Ce serait inconscient de vouloir l’utiliser pour une approche VRAIMENT scientifique.

Donc ne pas en attendre non plus trop au niveau de la réflexion méthodique et logique, cf; cet article: https://www.ladn.eu/tech-a-suivre/intelligence-artificielle-generative-gpt-3-est-plus-proche-du-comportement-dun-alien-que-de-celui-dun-humain/

Cet article reprend mon dada, coupler à des approches machine learning/deep learning l’IA symbolique pour avoir de l’explainable AI, sans quoi, on a un sacré problème sous notre nez.